Werbung

Vor nicht ganz fünf Jahren kündigte NVIDIA im kanadischen Montreal mit G-Sync eine zunächst unscheinbare Technologie an, die heute bei ambitionierten Spielern sicherlich nicht mehr wegzudenken ist und mit der man die Konkurrenz ebenfalls zum Umdenken bewog, die wenig später mit FreeSync nachzog.

Beide Technologien beendeten ein Relikt aus vergangenen Zeiten, das lange mitgeschliffen wurde: Vor wenigen Jahren noch war die Bildwiederholungsrate von Monitoren, also die Anzahl der Einzelbilder, die pro Sekunden auf einen Monitor gezeichnet wird, fest auf 60, 120 oder gar 144 Hz festgesetzt. Da moderne Grafikkarten aufgrund der unterschiedlich aufwendigen Spielszenen Bilder in sich stetig wechselnder Geschwindigkeit rendern und an den Monitor schicken, konnte es deswegen immer wieder zu störenden Tearing-Effekten und Microrucklern kommen.

Der Grund: Liefert die Grafikkarte mehr Bilder an den Monitor, als dieser eigentlich verarbeiten kann, wird ein neues Frame an den Monitor geschickt, obwohl das aktuell zu zeichnende Bild noch nicht fertig verarbeitet wurde. Es kommt zum störenden Tearing-Effekt, bei dem das Bild horizontal aus zwei einzelnen Frames geteilt wird. Mit aktiviertem V-Sync werden zwar nur komplette Bilder an den Monitor übertragen, fällt die Performance jedoch der Grafikkarte jedoch unterhalb die Bildwiederholfrequenz des Monitors, müssen Bilder doppelt dargestellt werden, was zu Rucklern führt. Bei G-Sync und FreeSync bzw. adaptive Sync wird die Bildwiederholfrequenz automatisch an die Bildausgabe der Grafikkarte angepasst. Tearing und Microruckler gehören somit der Vergangenheit an.

Anders als bei der Konkurrenz funktioniert G-Sync nicht nur in bestimmten Ranges, sondern nutzt die gesamte Bandbreite des jeweiligen Bildschirms, egal ob dieser 60, 100, 120, 144, 200 oder auch 240 Hz unterstützt. Gleichzeitig mit der Einführung von G-Sync-Monitoren wurden Geräte mit hoher Bildwiederholrate populärer. Schon damals arbeitete NVIDIA eng mit den Panel- und Display-Herstellern zusammen, um bei G-Sync-Monitoren eigene Standards zu setzen. Verbaut werden sollten ausschließlich hochwertige Displays, die bestimmten Qualitätsstandards entsprechen.

G-Sync wird mit HDR kombiniert

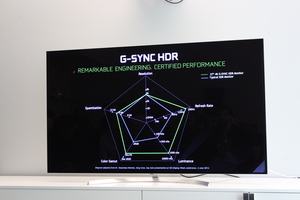

Mit G-Sync HDR will man das Spielerlebnis abermals auf ein neues Level hieven. G-Sync HDR ist zwar nicht grundlegend neu und wurde bereits zur CES 2017 in Las Vegas vorgestellt, in Kürze sollen die ersten Geräte jedoch endlich auf den Markt kommen. Auch diese Panels müssen für das G-Sync-HDR-Label gewissen Qualitätsstandards entsprechen und verschiedene Zertifizierungsstandards durchlaufen. Nur Geräte mit geeigneter Refreshrate, Reaktionsgeschwindigkeit sowie Farb- und Kontrastwerten sollen das Label tragen dürfen. Außerdem legt man großen Wert auf das OSD.

Das mag für die Hersteller zwar einen höheren Aufwand und ganz sicher auch höhere Kosten bedeuten, für den Käufer aber hat das einen riesigen Vorteil: Er kann sicher gehen, dass er ein Produkt mit einem gewissen Qualitätsstandard erhält, denn schon bei normalen HDR-Displays war das Problem, dass HDR nicht gleich HDR war. Vor allem Erstkäufer mussten dies bitter feststellen, da kein Standard definiert wurde. Geräte wurden teilweise als HDR beworben, ob obwohl sie High Dynamic Range (HDR10) nicht vollständig beherrschten.

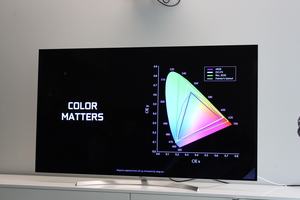

Die neuen G-Sync-HDR-Monitore sollen unter anderem größere Spitzenhelligkeiten und einen umfangreicheren Farbraum bieten, um das Bild möglichst realitätsnah zu zeichnen. NVIDIA spricht fünf verschiedene Voraussetzungen an, die ein gutes Display ausmachen können: Auflösung, Refreshrate, Helligkeit, Farbumfang und Farbtiefe. Je näher sich die einzelnen Werte am maximal möglichen befinden, desto besser ist das Display.

Ein typischer Monitor mit SDR-Panel bietet eine 4K-Auflösung, 60 Hz, 300 Nits, deckt den sRGB-Farbraum ab und stellt eine Farbtiefe von 8 Bit dar. Ein typisches G-Sync-HDR-Panel soll hingegen 4K, 144 Hz und 1.000 Nits erreichen und nahe am Kinostandard DCI-P3 sowie mit 10 Bit arbeiten können. Natürlich wird es vereinzelt Geräte mit schnellen 240 Hz und später vielleicht auch mit höherer nativer Auflösung und einem helleren Panel geben, die sich dann vom Durchschnitt noch einmal absetzen werden können – je näher man am Maximum ist, desto besser. Außerdem will NVIDIA G-Sync HDR stetig weiterentwickeln

Der DCI-P3-Standard kommt aktuell schon auf den Kino-Leinwänden zum Einsatz und deckt einen etwa 25 % größeren Farbbereich als der normale sRGB-Farbraum ab. Durch die 384 einzeln steuerbaren LED-Hintergrundbeleuchtungszonen, kann die Helligkeit eines G-Sync-HDR-Monitors präziser gesteuert werden. Dunkle Bereiche in Höhlen werden beispielsweise abgedunkelt, während die Flammen von Feuer oder einzelnen Leuchtstrahlern viel greller erscheinen als bei einem herkömmlichen SDR-Panel. Aufgrund der höheren Spitzenhelligkeiten und des größeren Farbraums, der fast schon an die gesamte Bandbreite des menschlichen Auges herankommt, soll so ein kontrastreicheres und natürlicheres Bild entstehen. Gleichzeitig soll der Detail-Reichtum gesteigert. Aufgrund des höheren Kontrasts verschwimmen sie weniger: Wolken können vom Himmel besser abgegrenzt werden, ein Feuerschwert erscheint nicht mehr einfach nur als ein in sich hell leuchtender Gegenstand.

Doch G-Sync HDR hat mit Virtual Reality oder dem normalen adaptive Sync eine Sache gemeinsam: Man mag die Technik in der Theorie zwar verstehen und den Nutzen erkennen, muss sie gleichzeitig aber live in Aktion erlebt haben, um sie tatsächlich schätzen zu lernen. Das Erlebnis lässt sich nicht auf Bilder darstellen oder im Video.

Hinzu kommt, dass G-Sync HDR ausschließlich mit GeForce-Grafikkarten funktioniert und obendrein vom jeweiligen Spiel unterstützt werden muss. Derzeit gibt es laut NVIDIA fast 40 Spieletitel, bei dem sich der HDR-Modus freischalten lässt. Mit dabei sind unter anderem „Assassin’s Creed Origins“, „Battlefield 1“, „Call of Duty: WWII“, „Far Cry 2“, “Final Fantasy XV”, “Star Wars Battlefront II” und “Tomb Raider”. Das kommende “Metro Exodus” soll ebenfalls HDR bieten.

Erste Geräte noch im Juni

Noch im Juni sollen die beiden ersten G-Sync-HDR-Monitore von ASUS und Acer auf den Markt kommen – und damit gut anderthalb Jahre nach ihrer Vorstellung, denn vorgestellt wurden der ASUS ROG Swift PG27UQ und der Acer Predator X27 bereits Anfang 2017. Beide Geräte setzen auf ein 27-Zoll-Panel mit einer nativen UHD-Auflösung von 3.840 x 2.160 Bildpunkten und arbeiten mit einer Bildwiderholrate von bis zu 144 Hz. Den Spezifikationen entsprechend kommt ein blickwinkelstabiles IPS-Panel mit Quantum-Dot-Technologie zum Einsatz, der DCI-P3-Farbraum wird für ein volles HDR10 abgedeckt und die Hintergrundbeleuchtung wird dynamisch in 384 Zonen reguliert. Beide Hersteller setzen auf ein Panel des chinesischen Hersteller AU Optronics. Anschlussseitig stehen jeweils einmal DisplayPort 1.4 sowie einmal HDMI 2.0 zur Verfügung.

Preislich wird man dafür allerdings tief in die Tasche greifen: Zumindest das ASUS-Modell wird in unserem Preisvergleich derzeit schon zu etwa 2.499 Euro gelistet.

| Nicht verfügbar | Nicht verfügbar | Nicht verfügbar |