Werbung

Die Supercomputer 2017 im November rückt näher und offenbar haben gleich mehrere Länder und Betreiber von Supercomputern vor dort Pläne zum Ausbau oder Neubau vorzustellen. Bereits bekannt ist, dass der Tianhe 2 in China von 33 PFLOPS (Rmax) auf 94,7 PFLOPS ausgebaut werden soll. Wohl weiter angeführt werden wird die Liste vom Sunway TaihuLight mit 93 PFLOPS, dessen Spitzenleistung allerdings bei 125 PFLOPS liegt.

Das japanische Unternehmen Fujitsu hat nun vom National Institute of Advanced Industrial Science and Technology (AIST) in Japan den Auftrag bekommen, einen neuen Supercomputer aufzubauen. Dieser wurde bereits angekündigt, nun aber gibt man für den AI Bridging Cloud Infrastructure (ABCI) auch die technischen Daten an. In Betrieb gehen soll der neuen Supercomputer im April 2018 und dann das drittschnellste Rechencluster sein.

Angepeilt sind eine Rechenleistung von 37 PFLOPS bei doppelter Genauigkeit, womit der ABCI den dritten Platz einnehmen würde. Allerdings ist die Auslegung des ABCI eine andere, denn das Institut möchte mit dem Supercomputer die Forschung und Entwicklung an künstlichen Intelligenzen unterstützen. Die dort notwendige Rechenleistung ist vor allem für Berechnungen mit halber Genauigkeit wichtig, sodass der Einsatz von NVIDIAs Tesla V100 besonders viel Sinn macht. 120 TFLOPS erreicht eine solche Karte alleine durch den Einsatz der dort verbauten Tensor Cores. Für den kompletten Supercomputer sollen es 550 PFLOPS sein.

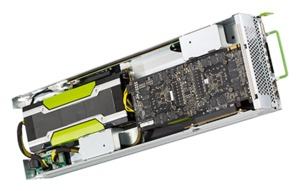

Der ABCI wird am Ende aus 1.088 Primergy CX2570 M4 Servern von Fujitsu bestehen. Jeder dieser Server verwendet wiederum zwei Prozessoren der Intel-Xeon-Gold-Serie, wobei das genaue Modell nicht genannt wird. Es kommen also insgesamt 2.176 Prozessoren zum Einsatz. Pro Server ebenfalls verbaut sind vier NVIDIA Tesla V100 im PCI-Express-Format, also 4.352 dieser Karten. Als schnellen Datenspeicher setzt Fujitsu auf eine unbekannte Anzahl an Intel SSD DC P4600 pro Server. Auch die Größte des Arbeitsspeichers ist nicht bekannt.

Unbekannt ist, welche Art von Interconnect Fujitsu einsetzen wird. Innerhalb des Servers dürfte dies PCI-Express sein, da die Tesla V100 im PCI-Express-Format kein NVLink unterstützt. Die einzelnen Server und Nodes untereinander benötigen aber ebenfalls einen schnellen Interconnect.

Gekühlt wird das komplette System über eine Heißwasserkühlung, was den Bedarf an Kühlleistung neben der ohnehin schon hohen Leistungsaufnahme der Hardware, reduzieren soll. Die 4.352 Tesla V100 nehmen rund 1,1 MW auf. Die 2.176 Xeon-Gold-Prozessoren kommen auch auf jeweils bis zu 200 W und damit auf fast 0,5 MW insgesamt. Bei einer Heißwasserkühlung wird mit etwa 60 °C warmen Wasser eine Kühlung der Komponenten auf etwa 80 °C ermöglicht. Die vier Tesla V100 pro Server sind allerdings semipassiv ausgelegt, verfügen also über ihren eigenen Kühlkörper, der jedoch vom Luftstrom im Server versorgt werden muss. In welcher Art und Weise dies beim ABCI von Fujitsu umgesetzt wird, bleibt abzuwarten.