Werbung

Der Kampf um die Vorherrschaft auf dem Technologiemarkt ist voll entbrannt. Das Aussperren von Huawei aus weiten Teilen der Geschäftsbereiche zeigt dies sehr deutlich. Die Abhängigkeiten vieler Unternehmen und Industrien von zentralen Unternehmen kann so schnell zu Problemen führen.

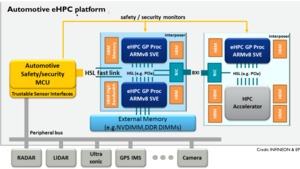

Die EU hat sich daher bereits vor einiger Zeit dazu entschieden, mit der European Processor Initiative (EPI) ein Konsortium zu erschaffen, welches eine eigene Prozessor-Architektur entwickeln und auf den Markt bringen soll. Letztendlich sollen die Bereiche High Performance Computing (HPC) bzw. ein General-Purpose-Prozessor, Beschleunigerhardware und Automotive abgedeckt werden.

Am Konsortium beteiligt sind Unternehmen wie Infineon, das Forschungszentrum Jülich, das Frauenhofer Institut, die BMW Group und das Karlsruher Institut für Technologie beteiligt. Benannt haben wir nur die deutschen Unternehmen, es kommen aber noch viele aus weiteren europäischen Ländern hinzu – insgesamt 23 Partner aus zehn Ländern sind daran beteiligt. Insgesamt wird das Projekt mit 1 Milliarde Euro von der EU gefördert. Etwa die Hälfte soll für die Entwicklung verwendet werden. Die zweite Hälfte soll für den Aufbau eines erstes Supercomputers genutzt werden.

Bereits 2021 soll das erste Design fertig sein. Es hört auf den Namen Rhea und wird eine General-Purpose-Architektur sein. Damit soll ein Pre-Exascale-Supercomputer aufgebaut werden, der etwa 100 TFLOPS erreicht. Zum Vergleich: Ebenfalls 2021 erwartet werden die ersten EFLOPS-Supercomputer mit Hardware von AMD (Frontier) und Intel (Aurora). Auch ein erster Automotive-Prozessor soll dann bereits fertig sein.

Bereits 2022 oder 2023 soll dann die zweite Generation fertig sein. Diese hört auf den Namen Cronos. Ab 2024 oder etwas später folgt dann bereits die dritte Generation, die allerdings noch keinen Namen hat.

Basis der Prozessoren soll zum einen ARM-IP sein, was dem Anspruch der Unabhängigkeit natürlich entgegensteht. Aber auch der offene RISC-V-Befehlssatz spielt neben weiterer externer IP eine Rolle. Bisher hat die European Processor Initiative aber noch keine technischen Details veröffentlicht. Insgesamt scheint das Projekt noch sehr am Anfang zu stehen und derzeit lässt sich schwer abschätzen, ob daraus tatsächlich Produkte entstehen werden, die den Markt erreichen.

Update:

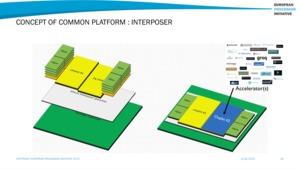

In einer Präsentation gibt die EPI weitere Informationen zum geplanten Design. Offenbar plant mit einem Chiplet-Design bestehend aus mehrere Komponenten. Diese befinden sich immer auf einem Package-Substrat, auf dem wiederum ein passiver Interposer befindet. Darauf befinden sich wiederum die unterschiedlichsten Chiplets, nebst HBM-Speicher.