Werbung

Die Skalierung bestehender Hardware steht für NVIDIA in diesem Jahr im Fokus. Zwar kommen die Quadro GV100 und Tesla V100 nun auch mit 32 GB an HBM2, die beschleunigte Zusammenarbeit gleich mehrerer Dutzend GPUs soll die Rechenleistung aber weiter steigern.

Eines der Standbeine soll das TensorRT 4 sein. TensorRT 4 liefert einen deutlich gesteigerten Durchsatz an INT8- und FP16-Berechnungen. Je nach Anwendung soll das Training damit um bis zu 70 % schneller ablaufen. Auf Seiten der Hardware ist die NVIDIA DGX-2 ein gutes Beispiel für die Skalierung. Hier arbeiten 16 Tesla V100 mit jeweils 32 GB HBM2 über einen NVSwitch zusammen und lassen zusammengenommen 81.920 Shadereinheiten rechnen.

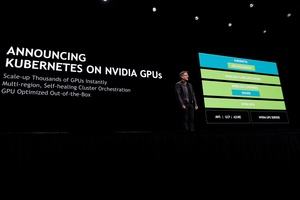

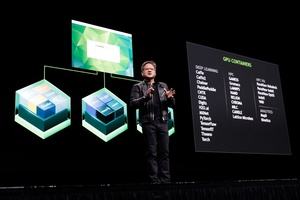

Arbeiten in einem Datacenter gleich mehrere DGX-2, muss das GPU-Cluster entsprechend angesprochen werden können. Über die GPU Cloud bietet NVIDIA bereits fertige Docker-Container, die schnell und einfach auf die Hardware angesetzt werden können. Kubernetes ermöglicht es das Ökosystem weiter auszuweiten. Beinahe beliebig viele GPUs und GPU-Cluster können hier zusammengefasst werden. Je nach Anforderungen an die Rechenleistung kann Kubernetes GPUs und GPU-Cluster zusammenfassen und dynamisch anpassen. Damit soll die Auslastung der Hardware optimiert werden.

Noch einen Schritt weiter geht NVIDIA, in dem auch zwei oder mehr Cloud-Instanzen hinzugenommen bzw. zusammengefasst werden können. Im Falle eines Ausfalls werden zusätzliche Instanzen, die als Backup vorgehalten werden, hinzugeschaltet werden.

Im Video ist die Funktionsweise von Kubernetes sehr gut demonstriert. Dazu werden vier von acht GPUs deaktiviert und andere, in Reserve gehaltene GPUs, springen sofort ein. Dies geschieht innerhalb von wenigen Sekunden und das Training wird ohne Unterbrechung fortgesetzt.

Das Video zeigt zudem noch einmal einen Leistungsvergleich für das Training eines Deep-Learning-Netzwerkes im Vergleich zu einem CPU-basierten System.

Datenschutzhinweis für Youtube

An dieser Stelle möchten wir Ihnen ein Youtube-Video zeigen. Ihre Daten zu schützen, liegt uns aber am Herzen: Youtube setzt durch das Einbinden und Abspielen Cookies auf ihrem Rechner, mit welchen Sie eventuell getracked werden können. Wenn Sie dies zulassen möchten, klicken Sie einfach auf den Play-Button. Das Video wird anschließend geladen und danach abgespielt.

Ihr Hardwareluxx-Team

Youtube Videos ab jetzt direkt anzeigen