Werbung

In diesem Jahr scheint sich NVIDIA auf der GPU Technology Conference auf einen Ausbau der bestehenden Produkte und Technologien zu konzentrieren. So präsentiert man eine Quadro GV100 mit 32 GB HBM2 und auch die Tesla V100 kann ab sofort mit der doppelten Speicherkapazität bestückt werden. Um diese schnelle GPU-Beschleuniger besser einsetzen zu können, muss aber nicht nur die einzelne Hardware schneller werden, sondern auch die Zusammenarbeit derselbigen.

Die GV100-GPU verfügt über einen integrierten NVLink-Interconnect. NVLink 2.0 kann 50 GB/s in Sende- und Empfangsrichtung pro Link übertragen, da die Anzahl an Links mit der GV100-GPU auf sechs erhöht worden. Daraus ergibt sich eine kommulierte Bandbreite von 300 GB/s für die GV100-GPU. Die zwei zusätzlichen Links können für den Aufbau neuer Infrastruktur-Systeme genutzt werden. Bisher ermöglichte NVLink beispielsweise die Anbindung von acht Tesla P100 und über einen PCI-Express-Switch konnte auch ein Prozessor angebunden werden. Mit NVLink 2.0 stehen nun zwei zusätzliche Links zur Verfügung, die beispielsweise für zwei CPUs verwendet werden können. Im Falle der Tesla-V100-GPU-Beschleuniger können aber auch bis zu 64 dieser GPUs zusammengefasst werden – zumindest in der Theorie.

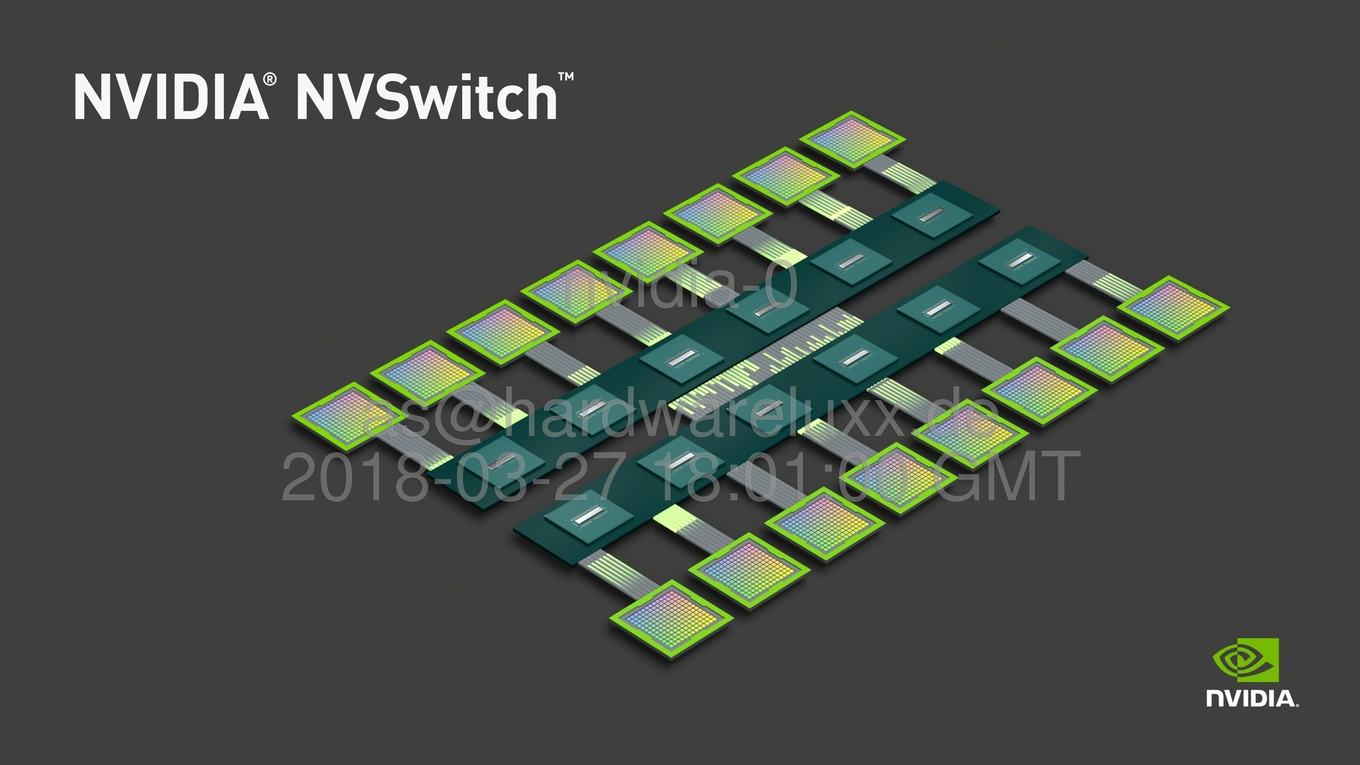

Mit dem NVSwitch präsentiert NVIDIA nun einen Switch für den Interconnect, um bis zu 16 Tesla V100 untereinander zu verbinden. Bis zu 7,2 TBit/s können über den Switch ausgetauscht werden. Der Switch besteht aus einzelnen Chips, die in TSMC in 12 nm gefertigt werden und jeweils über 18 Links verfügen. Jeder einzelne Chip besteht aus 2 Milliarden Transistoren.

Verwendet wird ein solcher Switch unter anderem im neuen DGX-2, der 2 PFLOPS an Rechenleistung in sich vereint. Mit dieser Rechenleistung bei einer Bauhöhe von gerade einmal acht Höheneinheiten spricht NVIDIA vom kompaktesten Computer dieser Klasse. So können komplette Racks an Rechnern durch einen DGX-2 ersetzt werden. Ein DGX-2 kann das Deep-Learning-Netzwerk FAIRSeq um den Faktor zehn schneller trainieren als der DGX-1 – unter anderem aufgrund der schnellen Anbindung der 16 Tesla V100. Die weiteren Komponenten sind zwei Intel Xeon Platinum, 8x EDR IB/100 GbE, 1,5 TB Arbeitsspeicher, 30 TB an NVMe-SSDs und eine Stromversorgung von 10.000 W.

Der DGX-1 mit acht Tesla V100 soll ebenso wie die DGX Station mit vier GPU-Beschleunigern weiter angeboten werden. Der Preis der DGX-2 liegt bei 399.999 US-Dollar.