Werbung

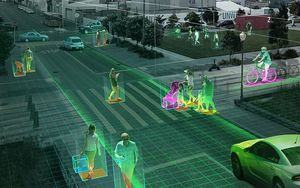

NVIDIA eröffnet die GPU Technology Conference mit Neuankündigungen im Bereich der Videoanalyse mithilfe der eigenen GPUs und den dazugehörigen SDKs. Den Anfang macht dabei Metropolis, eine Plattform für die intelligente Videoanalyse. Die Videoanalyse ist eines der wichtigsten Anwendungsfelder für Hardware aus dem Hause NVIDIA, denn vor allem durch den starken Gebrauch von Überwachungskameras wird eine Automatisierung bei der Analyse immer wichtiger. Derzeit werden diese Videodaten fast ausschließlich vorgehalten, nicht aber weiter analysiert – was vielen aus Datenschutzgründen sicherlich auch entgegen kommt. Eine allumfassende Analyse sollte demnach nicht das Ziel einer solchen Technik sein.

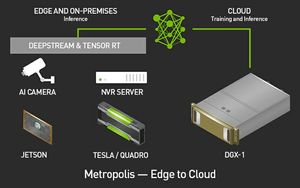

Die entsprechende Hardware stellt NVIDIA in Form von Quadro-Grafikkarten, die sich gleich mehrere Videostreams annehmen. In kleinerem Umfang soll diese Arbeit auch von embedded Systemen mit Jetson-Plattform übernommen werden. Da solche Analysen lokal, dort wo die Daten anfallen, aber nicht immer möglich sind, bietet NVIDIA auch eine entsprechende NVR-Server-Schnittstelle mit Cloudanbindung. Dort übernehmen dann DGX-1-Server die Analysearbeit.

"Deep learning is enabling powerful intelligent video analytics that turn anonymized video into real-time valuable insights, enhancing safety and improving lives," sagte Deepu Talla, Vizepräsident und General Manager der Tegra-Business-Sparte bei NVIDIA. "The NVIDIA Metropolis platform enables customers to put AI behind every video stream to create smarter cities."

Metropolis wird als Plattform gerade erst gestartet und soll Bestandteil größerer Überwachungsnetzwerke werden.

Datenschutzhinweis für Youtube

An dieser Stelle möchten wir Ihnen ein Youtube-Video zeigen. Ihre Daten zu schützen, liegt uns aber am Herzen: Youtube setzt durch das Einbinden und Abspielen Cookies auf ihrem Rechner, mit welchen Sie eventuell getracked werden können. Wenn Sie dies zulassen möchten, klicken Sie einfach auf den Play-Button. Das Video wird anschließend geladen und danach abgespielt.

Ihr Hardwareluxx-Team

Youtube Videos ab jetzt direkt anzeigen

VRWorks Audio und ein 360° Video SDK

Ebenfalls auf der GTC 2017 angekündigt wird ein neues SDK für VRWorks Audio. VRWorks Audio wurde im Rahmen der Pascal-Architektur vorgestellt. Ein möglichst realistischer 3D-Sound wird in Spielen und professionellen Anwendungen immer wichtiger. Die Ortung der Geräuschquellen wird per Zeit- und Lautstärke-Unterschied ermöglicht. Hinzu kommen Reflektionen auf den Schultern, die vom Gehör bzw. dem Gehirn ausgewertet und damit die Höhe der Soundquelle bestimmt werden. All dies muss in Software simuliert werden, um nicht nur visuell, sondern auch in einer Audiowellt gefangen zu werden.

Eine aktuelle GPU von NVIDIA soll in der Lage sein, tausende von Audio-Pfaden berechnen zu können – ähnlich wie dies bei Raytracing der Fall ist. Dazu werden die Compute-Eigenschaften der GPU verwendet. Derzeit arbeitet NVIDIA mit zwölf Echoquellen für maximal 16.000 Soundpfade. NVIDIA bezeichnet VRWORKS Audio als die erste Echtzeitberechnung von 3D-Audio. VRWorks Audio ist inzwischen Bestandteil der von Epic’s Unreal Engine 4.

Neben einem möglichst realistischen Audio spielt für NVIDIA natürlich die visuelle Darstellung eine wichtig Rolle. In diesem Zuge wird das VRWorks 360 Video SDK vorgestellt. Darin ermöglicht NVIDIA das Zusammenführen von 360-Grad-Videos aus mehreren Kameras in Echtzeit – natürlich nur, wenn eine entsprechend starke Grafikkarte zum Einsatz kommt. NVIDIA spricht hier von zwei Quadro P6000 mit GP100-GPUs und High Bandwidth Memory der zweiten Generation. In einem praktischen Beispiel spricht NVIDIA von einem Z CAM’s V1 PRO VR Kamerasystem mit acht UHD-Kameras.

Die NVIDIA VRWorks 360 Video und Audio SDKs sind unter http://www.developer.nvidia.com/vr verfügbar.