Werbung

Bisher hat Google seine Tensor Processing Units oder kurz TPUs nur für eigene Projekte verwendet. Dazu gehören der Suchalgorithmus ebenso wie Übersetzungen per Google Translate. Nun aber sollen die TPUs auch den ersten Beta-Nutzern der Cloud Platform zugänglich gemacht werden.

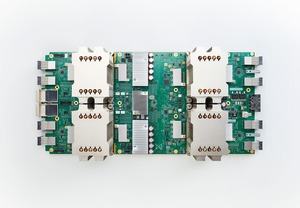

Bei der TPU handelt es sich um einen Custom-ASIC (Application Specific Integrated Circuit), der speziell auf das Machine Learning mittels TensorFlow zugeschnitten ist. Die zweite Generation der TPUs berechnet 256 × 256 Multiplizier/Aufaddier-Einheiten (Multiplier/Accumulator, MAC) – bestehend aus 2x 128 x 128 Rechencluster. Hinzu kommen 16 GB an HBM2. Diese 16 GB erreichen eine Speicherbandbreite von 600 GB/s und arbeiten demnach mit einem Takt von etwas weniger als 600 MHz. Die Rechenleistung pro TPU gibt Google mit 45 TFLOPS an. Zum Vergleich: Ein Intel Intel Xeon E5-2699 v3 kommt auf 2,6 TFLOPS und eine NVIDIA Tesla V100 mit GV100-GPU und den sogenannten Tensor Cores bringt es auf 120 TFLOPS für hier relevante INT8-Berechnungen. Eine Cloud-TPU-Konfiguration kommt demnach auf 180 TFLOPS. Allerdings macht Google weiterhin keinerlei Angaben über die Leistungsaufnahme seiner TPUs.

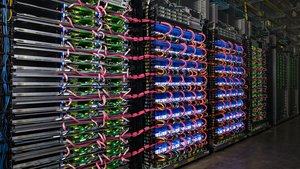

Jede TPU verfügt über einen von Google eigens entwickelten Interconnect, über den man aber keine weiteren Angaben macht. Er soll aber besonders schnell sein, was ebenfalls eine wichtige Komponente für das Training eines Deep-Learning-Netzwerkes ist. Als maximale Ausbaustufe beschreibt Google ein TPU Pod. Dabei werden 64 TPUs zusammengeschaltet. Diese erbringen eine Rechenleistung von 11,5 PFLOPS und bieten 4 TB an HBM2.

Eine Cloud-TPU-Konfiguration besteht aus vier dieser Chips, kommt also auf 64 GB HBM2 und acht „Dual-Cores". Diese kleinste Cloud-TPU-Konfiguration kann durch Nutzer angemietet werden. Die Kosten belaufen sich auf 6,50 US-Dollar pro Cloud TPU und pro Stunde.

Datenschutzhinweis für Youtube

An dieser Stelle möchten wir Ihnen ein Youtube-Video zeigen. Ihre Daten zu schützen, liegt uns aber am Herzen: Youtube setzt durch das Einbinden und Abspielen Cookies auf ihrem Rechner, mit welchen Sie eventuell getracked werden können. Wenn Sie dies zulassen möchten, klicken Sie einfach auf den Play-Button. Das Video wird anschließend geladen und danach abgespielt.

Ihr Hardwareluxx-Team

Youtube Videos ab jetzt direkt anzeigen