Werbung

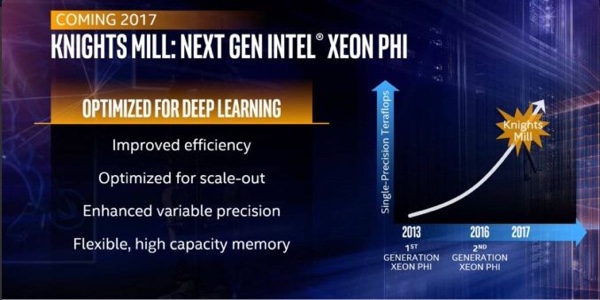

In einer Technical Session des Intel Developer Forums in San Francisco hat Intel seine Pläne für weitere und zukünftige Xeon-Phi-Produkte und die dazugehörigen GPU-Beschleuniger der Knights-Generationen veröffentlicht. Demnach soll der immer stärker wachsende Bedarf an Hardware für Deep-Learning-Netzwerke im kommenden Jahr mit Knights Mill bedient werden.

Die Ankündigung von Knights Mill ist aber gleichzeitig auch ein Umdenken bei Intel. Denn ursprünglich war nach der aktuellen Knights-Landing-Generation, die bis auf die High-End-Variante bereits ausgeliefert wird, Knights Hill geplant. Knights Hill sollte eine echte 3. Generation für Xeon Phi im 10-nm-Prozess werden. Doch vermutlich aufgrund des späten Starts der 10-nm-Produktion (mit der Massenproduktion ist nicht vor Ende 2017 zu rechnen), schiebt man nun Knights Mill als Zwischenlösung sein.

Mit Knights Mill adressiert Intel aber womöglich stärker den wachsenden Markt an Deep-Learning-Hardware, wo nicht FP16- , FP32- oder gar FP64-Berechnungen die wichtigste Rolle spielen, sondern viele kleine Berechnungen in INT8 möglichst schnell durchgeführt werden müssen. Diese INT8-Berechnungen spielen sowohl beim Anlernen von Deep-Learning-Netzwerken eine wichtige Rolle, wie auch bei der Auswertung von Daten in solchen Netzwerken. Da sich Intel aber weiterhin möglichst breit aufstellen möchte, führt man Mixed Precision ein. Mixed Precision beschreibt dabei die Möglichkeit von FP16- oder FP32-Berechnungen zusammengefasst zu werden. NVIDIA hat einen ähnlichen Modus auch in der aktuellen Pascal-Architektur. Derzeit ist aber nicht klar, was Intel damit genau meint, also welche Floating Point Formate nun letztendlich unterstützt werden sollen. FP16 und kleinere Modi fehlen bei Knights Landing komplett.

Im Zusammenhang mit Knights Mill nennt Intel auch eine verbesserte "Scale Out Performance". Derzeit ist aber unklar, was Intel damit meint. Möglich wäre ein deutlich schnellerer Interconnect, schneller als die aktuelle Omni-Path-Generation mit 100 GB/s. Es wäre aber auch möglich, dass Intel damit etwas völlig anderes meint. Das Unternehmen hat aber weiterhin große Cluster aus Xeon-Phi-Beschleunigern im Hinterkopf. Deren Anbindung untereinander spielt eine entscheidende Rolle. Änderungen könnten es auch beim MCDRAM geben, der aktuell bis zu 16 GB groß ist und dabei 500 GB/s erreicht. Intel spricht im Vortrag nur von einem „fexible, high capacity memory".

Derzeit will und kann Intel noch keine weiteren Details zu Knights Mill veröffentlichen. Die Knights-Landing-Generation wurde auch gerade erst offiziell vorgestellt und kann nun in größeren Stückzahlen ausgeliefert werden.