Werbung

Bereits im Dezember des vergangenen Jahres kündigte AMD seine GPUOpen-Initiative an und sprach sich darin für einen Open-Source-Gedanken für die Nutzung von Programmierschnittstellen aus. Damit möchte AMD vor allem für die Entwickler weitere Anreize schaffen die eigene Hardware zu verwenden. Weite Teile der zur Verfügung stehenden Software sollen nun weiter verbessert und teilweise als Open-Source angeboten werden, damit diese Verbesserungen schneller und auch durch externe Entwickler getrieben eingebaut werden können. Dies betrifft bestimmte Bibliotheken der SDKs (LiquidVR, FireRender, DX-11- und DX-12-Examples) ebenso wie Tools für bestimmte visuelle Effekte (TressFX 3.0, ShadowFX und GeometryFX). Insgesamt soll die Entwicklung damit effizienter und einfacher werden.

Der zum damaligen Zeitpunkt noch recht weit gefasste Ansatz wurden nun etwas genauer ausgeführt und betrachtet dabei die Nutzung bei der Spieleentwicklung und Grafikeffekten im Besonderen. Den Fokus rückt AMD dabei auf spezielle SDKs wie AO FX, GeometryFX, ShadowFX, TressFX und LiquidVR. Damit stellt AMD diese in direkter Konkurrenz zu den zahlreichen GameWorks-SDKs aus dem Hause NVIDIA. Sie sind als Blackbox und durch ihre proprietäre Natur immer wieder in der Kritik - nicht nur zwischen AMD und NVIDIA, sondern auch zwischen den verschiedenen Unterstützergruppen in Form von Spieleentwicklern. GPUOpen soll ein Gegenpol zu dieser Strategie sein. Allerdings ist AMD nun darauf angewiesen, dass Entwickler die Vorteile auch für sich erkennen und verstärkt auf eine Unterstützung solcher freien Technologien setzen. So lange NVIDIA einige Entwickler aber direkt an sich und an die Unterstützung von GameWorks bindet, dürfte dies recht schwer werden.

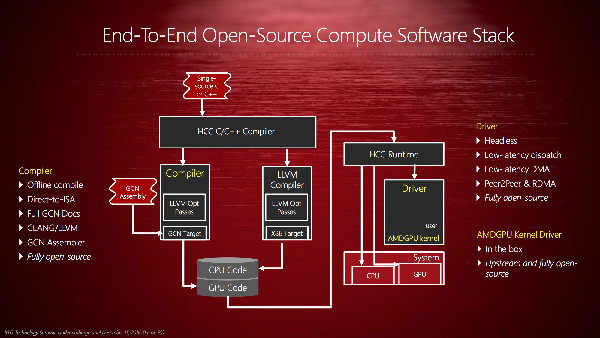

Neben dem Open-Soure-Gedanken bei den Entwicklungs-Bibliotheken für Spiele sieht AMD die Vorteile aber vor allem im professionellen Bereich. Auch hier soll recht weitläufig freie Software eingesetzt werden. Vom Treiber, über das Training für Deep Learning, bis hin zu Anwendungen in den verschiedenen Industriebereichen. Ein Beispiel ist der Headless-64-Bit-Treiber, der für geringere Latenzen und weniger Overhead sorgen soll - seine Entwicklungsbasis ist inzwischen veröffentlich worden. Den Grundgedanken aber am besten beschreiben kann der HCC – Heterogenious Compute Compiler. Dabei handelt es sich um einen Open-Source-Compiler für C++, der Code für GPUs zusammenstellen soll. Unter anderem wird damit der sogenannte HIP realisiert. Dabei handelt es sich um einen Konverter, der CUDA-Code zu C++ konvertiert, der dann auch auf AMD-GPUs ausgeführt werden kann.

Bis wir erste Ergebnisse der GPUOpen-Initiative sehen werden, wird es aber noch einige Zeit dauern. Die Entwickler müssen sich auf die neue Strategie bei AMD erst einstellen und entsprechend ihre Projekte umsetzen. AMD geht es aber sicherlich auch vermehrt darum eine andere Gedankenwelt in die aktuell recht geschlossenen Entwicklersysteme zu bekommen. Ob man die dazu notwenige Durchdringung wird aufbringen können, steht allerdings in den Sternen.