Werbung

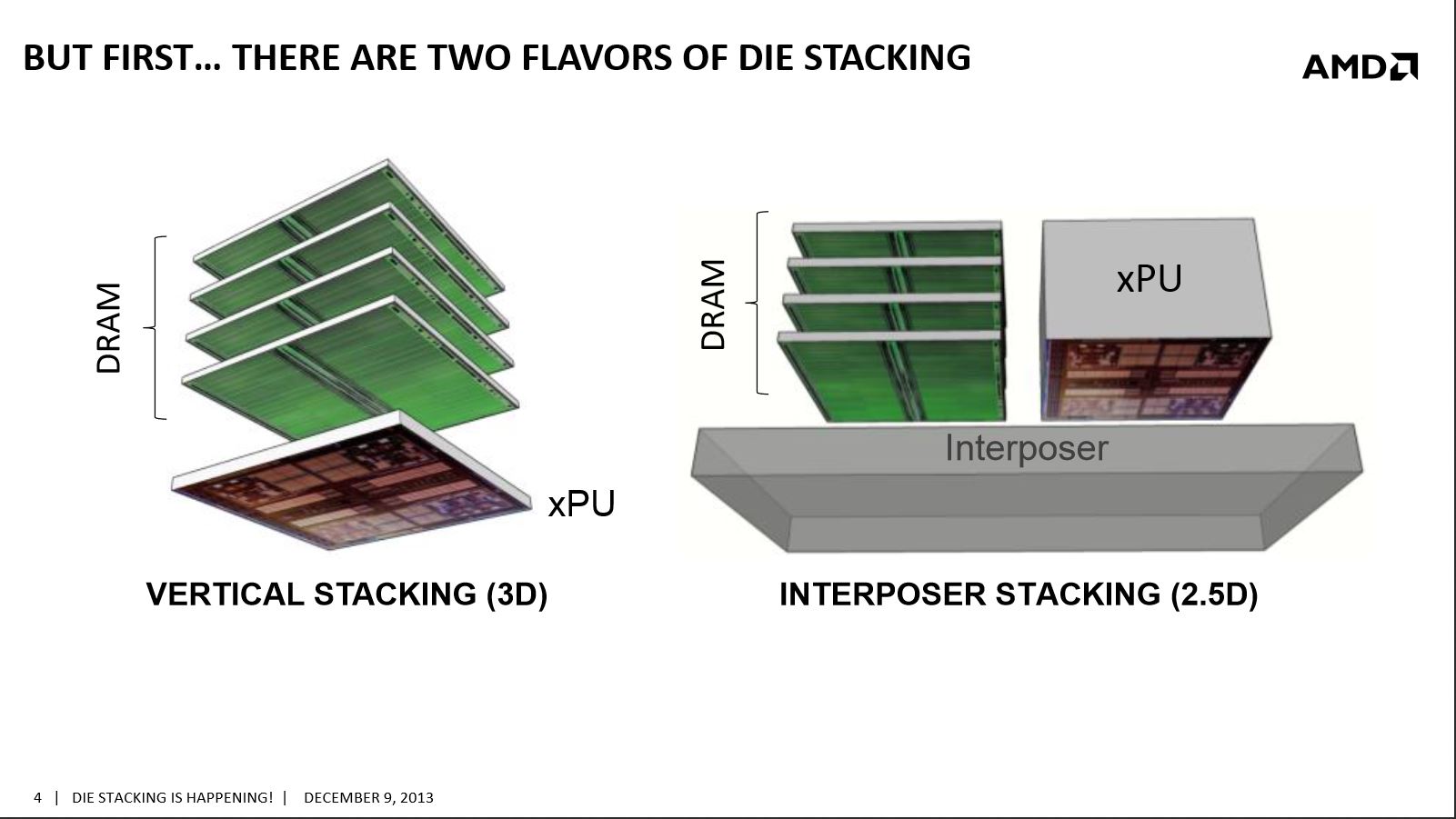

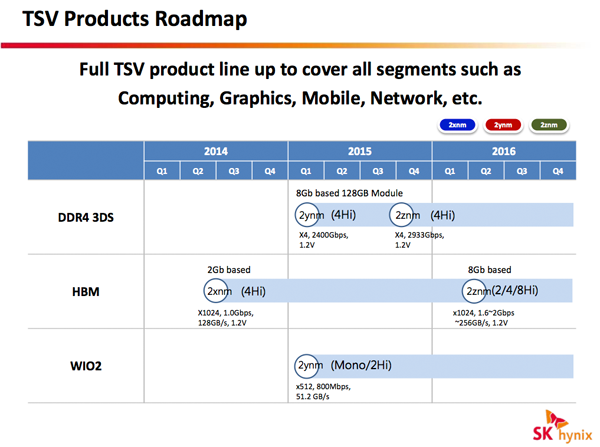

AMD arbeitet in Kooperation mit dem Speicherlieferanten SK Hynix bereits seit drei Jahren an sogenanntem HBM-(High-Bandwith-Memory)-Speicher. Dieser soll den aktuell genutzten GDDR5-Standard ablösen. Bei dieser Technologie werden die einzelnen Speicherbausteine schlichtweg übereinander gestapelt (ähnlich wie bei NVIDIAs 3D-Speicher), sodass die Bandbreite effektiv weiter steigen kann. So versucht der Grafikspezialist AMD zumindest ein Nadelöhr zu beseitigen. Zusätzlich wird ein HBM-Baustein weniger Strom verbrauchen als ein vergleichbarer GDDR5-Baustein. Es werden Betriebsspannungen von 1,2 Volt angesetzt.

Wann der Speicher mit einer neuen Grafikchip-Generation auf den Markt kommen soll, lässt sich nur erahnen. Auf einer Roadmap ist vom dritten Quartal 2014 die Rede. Jedoch könnte damit auch die Auslieferung gemeint sein. Der Marktstart der jeweiligen Grafikkarten könnte dementsprechend noch in weiter Ferne liegen. Auch spielt es eine Rolle, wie die neuen Fertigungen bei TSMC mitspielen. Es gibt bereits Gerüchte, dass AMD auch die Grafikchip-Herstellung bei zukünftigen Generationen bei Globalfoundries stattfinden lassen wird.