Werbung

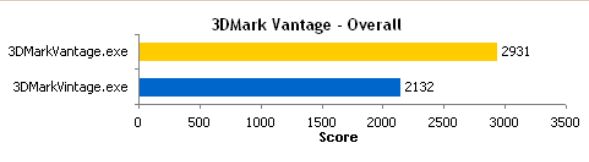

Immer mal wieder wurden in der Vergangenheit Vorwürfe laut, Grafikkartenhersteller würden mit Mogeleien für bessere Ergebnisse in den beliebten 3DMark-Programmen sorgen. Normalerweise trafen solche Vorwürfe die Hersteller diskreter 3D-Grafikkarten. Die Kollegen von Tech Report haben herausgefunden, dass auch Intel bei seinen integrierten Grafiklösungen für optimierte Ergebnisse im 3DMark Vantage sorgt. Demnach erkennen die Intel-Treiber, wenn die ausführbare Datei des Benchmarks startet. Daraufhin werden Aufgaben der IGP der CPU zugeteilt und ein deutlich besseres Ergebnis erreicht. Tech Report belegt diese Behauptung durch ein einfaches Umbennenen der "3DMarkVantage.exe" in "3DMarkVintage.exe". Bei der überprüften IGP (G41) resultiert daraus ein deutlicher Leistungsunterschied. Eine solche "Optimierung" verstösst gegen die von Futuremark aufgestellten Regularien. Auf Anfrage der Kollegen räumte Intel ein, dass die IGP-Treiber entsprechend programmiert wurden. Das wäre auch für mehrere Spiele (Call of Juarez, Crysis, Lost Planet: Extreme Conditions und Company of Heroes) der Fall.

In ausgewählten Szenarien, wie vor allem dem 3DMark Vantage, erscheint die Intel-IGP so gegenüber eigentlich überlegener Konkurrenz (wie beispielsweise AMDs 785G) im Vorteil.